La banca o el sector turístico, por citar dos sectores, ya están metidos de lleno en el desarrollo de chatbots o asistentes virtuales que permiten vender productos de forma más cómoda y rápida.

Su funcionamiento es sencillo. Están allí donde se encuentra el usuario. Redes sociales, correo electrónico, páginas webs... No son cosa de ahora pero en este momento es cuando su uso está a punto de generalizarse. ¿Recuerdan la amable señorita de IKEA con la que hablaban al entrar en la web y le pedían ayuda? Pues básicamente estamos hablando de eso pero con mucha más inteligencia por detrás. La idea es mantener conversaciones escritas u orales con programas informáticos.

¿Inteligencia? No exactamente. Es lo que en el sector llaman 'redes neuronales artificiales'. En la práctica, un chatbot no es inteligente. Lo que sí tiene es una capacidad computacional muy grande. Esto permite nutrir a estos 'robots' con frases, palabras, construcciones gramaticales que son capaces de interpretar e incorporar a una base de datos.

Nuestro chatbot entiende mejor a la gente mayor que a los milenials"

Al final, grosso modo, lo que hace un chatbot es ver qué debe responder cuando esas palabras se juntan de una u otra manera. Por probabilidad, al final resuelve, en función de lo que haya ido almacenando en memoria, cuál es la mejor respuesta. Y es capaz de aprender con cada nueva conversación, con cada nuevo usuario -esto se viene a denominar machine learning-, puesto que en esa gran base de datos se van guardando también las respuestas y la satisfacción o no de las personas reales que interactúan con él en función de cada interacción. Eso es lo que permite a un usuario hablar con una máquina, interactuar con ella y recibir respuestas aparentemente humanas.

Google y Amazon, por poner dos ejemplos, ya trabajan con Cortana y Alexa, sus dos asistentes virtuales, dos chatbots, que permiten al usuario realizar diferentes operaciones como escuchar una determinada canción, activar la radio o realizar búsquedas en internet.

Faltas de ortografía ha habido siempre y lo que pasa es simplemente que ahora todo el mundo escribe y su ortografía está más expuesta a los demás"

"Para ponerlo de la manera más sencilla posible, un chatbot es un programa informático capaz de tener diálogos con humanos a través de las aplicaciones de mensajería instantánea más populares, como Facebook o Messenger. La inteligencia de este programa reside en que puede interpretar el motivo o intención de la conversación, entender las respuestas de un humano y dar las respuestas adecuadas en cada situación, gracias a la inteligencia artificial, de ahí que los denominemos inteligentes", asegura Beatriz Zabalegui, responsable de marketing de iAdvize España, empresa que ofrece el desarrollo de chatbots a medida a empresas.

El lenguaje de los milenials

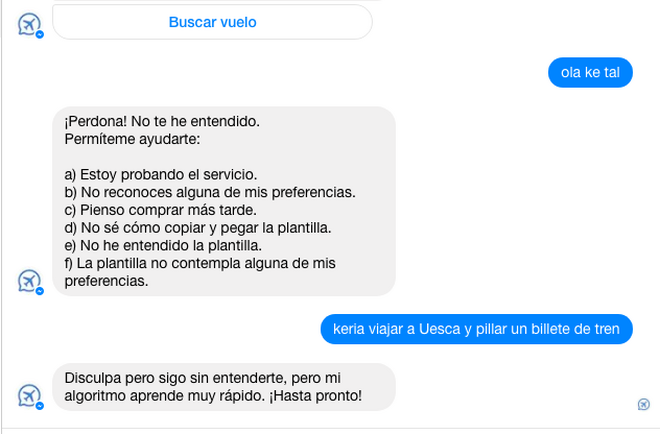

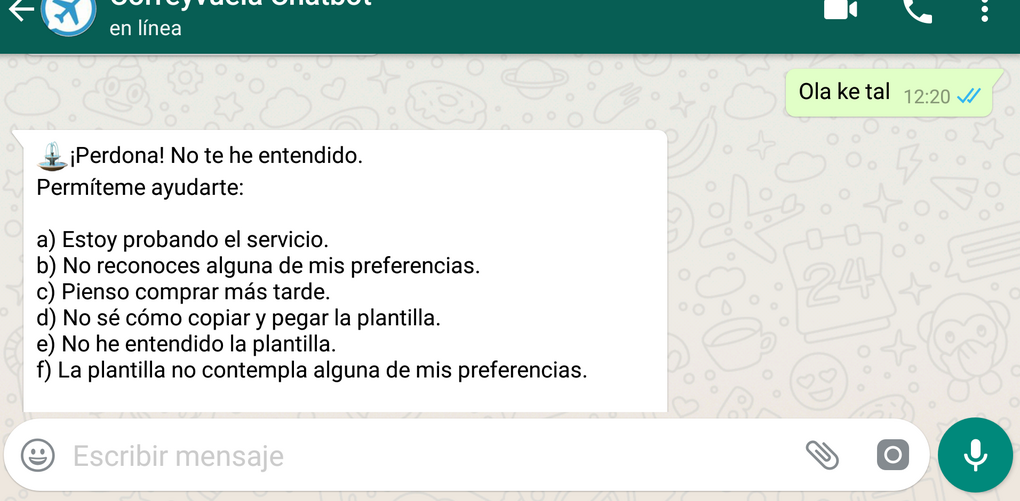

La clave en cualquier 'conversación' entre un chatbot y una persona está en el código, en el lenguaje que se maneja, y que es el que permitirá que un ordenador y una persona se entiendan. Es algo similar al lenguaje entre humanos. Dos hispanoparlantes se entenderán entre sí siempre, pero ¿qué sucede si uno de los dos hispanohablantes maneja incorrectamente el castellano? Pues que no se harán entender. Algo parecido a lo que sucede con los chatbots.

La contracción en palabras y expresiones que tanto utilizan los milenials viene de la época de los mensajes cortos

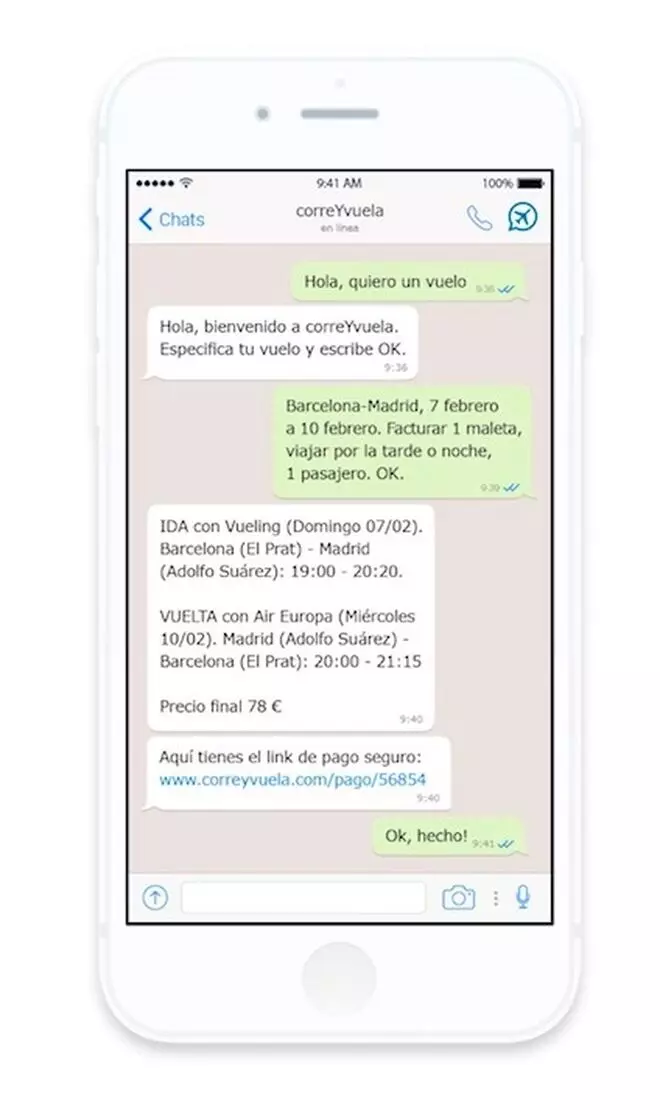

"Nuestro chatbot entiende mejor a la gente mayor que a los milenials. La gente joven escribe peor. No lee los mensajes ni responde acorde con la conversación, ese es uno de los principales escollos a la hora de desarrollarlo", asegura Juan Prim, fundador y CEO de correYvuela, compañía que ya tiene chatbots en Telegram, Whatsapp, Facebook y SMS, que son capaces de interactuar tanto en inglés como en español.

¿Qué dice la RAE?

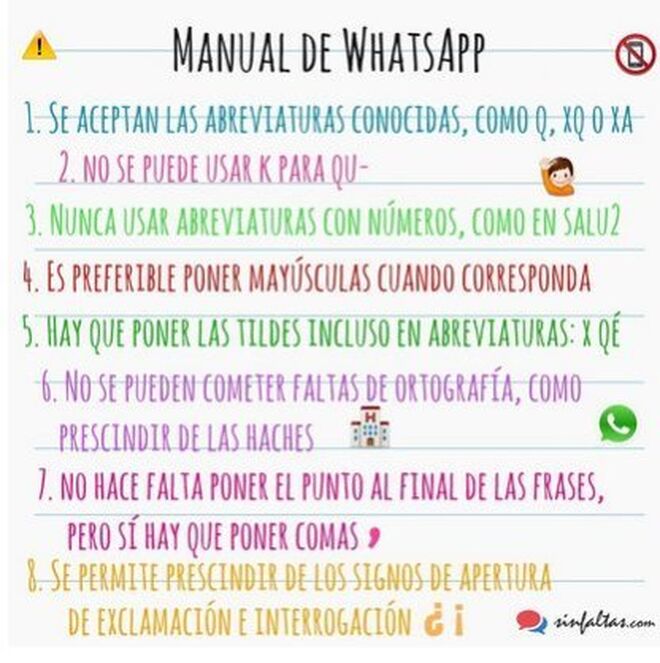

Las nuevas tecnologías están cambiando el lenguaje, al margen de lo que suceda con las nuevas generaciones y su nivel de ortografía. Es común ver la utilización de "ke" en lugar de "que" y "ola" en lugar de "hola". Todo empezó en la era de los mensajes cortos, hace unos 15 años. Originalmente tenían un coste de en torno a los 0,25 euros y sólo permitían enviar 160 caracteres. Aunque era una aplicación pensada para el mercado empresarial los jóvenes fueron quienes le dieron dimensión. Y para economizar más, comenzaron a contraer palabras, a utilizar abreviaturas no comunes.

"Faltas de ortografía ha habido siempre y lo que pasa es simplemente que ahora todo el mundo escribe y su ortografía está más expuesta a los demás. No se escribe peor, se escribe más. Lo malo es que esto puede crear contagio si solo se lee lo que se publica en redes sociales, donde más gente que desconoce las reglas de ortografía escribe, y no en libros, donde se suelen respetar las reglas", asegura Juan Romeu, cofundador y lingüista en la web Sinfaltas.com, antiguo empleado en la RAE (Real Academia de la Lengua) y autor del libro 'Lo que el español esconde'.

A cambio de todo esto lo bueno es que, como todos los días escribimos, es más fácil memorizar y autorizar las normas si nos las aprendemos. Pero los que escribimos sin faltas seguiremos escribiendo sin faltas en textos formales por mucho que en contextos informales nos tomemos algunas licencias. Con respecto a las abreviaciones, "Nebrija, el primer ortógrafo, las usaba", matiza Romeu,

Es relativamente sencillo que una palabra que se extienda en el uso acabe aceptándose, pero con la ortografía no es tan fácil. Por ejemplo, jamás se aceptaría «haber si vienes» por «a ver si vienes», según asegura Romeu, por mucha gente que lo escribiera de la primera forma. En lo único que puede variar la ortografía es en la simplificación de formas, como ocurre en las reducciones de vocales iguales («reemplazar» > «remplazar») o en escritura en una sola palabra de palabras que se escribían separadas. La RAE ya dice que se puede escribir «ahivá» () y puede que dentro de poco se acepte «agusto» (por «a gusto»). Pero, en general, pocos cambios más podría haber. A no ser, claro, que se hiciera una gran reforma de eliminación de las haches, simplificación de los pares «b/v» y «g/j», etc. Pero de momento no parece que sea conveniente ni que esté cerca esa gran reforma. También es interesante saber que estamos notando un rebote en la sociedad. La gente está cada vez más preocupada por su ortografía.

Los chatbots ya se podían crear en 1950

Volvamos a los chatbots. La fiebre actual que han levantado las empresas alrededor de este tipo de asistentes solo responde al dinero. Y no al que puedan ganar, que también, sino al coste de los chatbots. "Desarrollar un chatbot era sumamente caro. Ya se podían construir a hace casi 70 años, en torno a 1950, pero se necesitaba una capacidad computacional que económicamente los hacía inviables, cosa que ahora está muy superada", asegura asegura David Fernández, director de Desarrollo de Negocio de Inbenta, compañía dedicada al procesamiento del lenguaje natural a través de Inteligencia Artificial.

Y es que para desarrollar un chatbot es necesario realizar múltiples operaciones que aseguren, mediante la práctica, que la respuesta va a ser la acertada a cada cuestión del usuario. Es decir, antes de que un chatbot esté listo debe haber sido entrenado mediante millones de 'conversaciones' con él. Esta es la capacidad computacional que se necesitaba para desarrollar los chatbots en un periodo de tiempo razonable, y que hace siete décadas era inasumible económicamente por el coste de procesamiento de la época. Ahora los ordenadores son infinitamente más potentes y su coste mucho menor.

"Lo complejo es ir de un 'hola' a una venta. Estamos en la carrera de que una máquina le pueda vender algo a una persona. Hay mas de 100.000 desarrolladores de chatbots para que los usuarios puedan interactuar con ellos en Facebook pero solo hay 20 capaces de venderle productos al usuario. Son Dominos Pizza, Uber, McDonalds, y correYvuela", asegura Prim.

Los chatbots aprenden a través de códigos de programación y enriquecen sus conocimientos recopilando las respuestas durante la conversación. Por el momento, se encargan de realizar las tareas más repetitivas dentro del programa de atención al cliente de cada compañía, que representan aproximadamente el 20% del total. Por tanto, podemos decir que el chatbot aprende tareas por asociación de conceptos. "Por ejemplo, para dar respuestas a preguntas frecuentes como '¿cómo puedo cancelar mi subscripción?'; el chatbot identifica las palabras cancelar y suscripción y ofrece la respuesta adecuada para esta petición, basándose también en la propia experiencia de otros usuarios. Esto funciona con variables, lo que permite a la marca categorizar las respuestas recopiladas por el bot", asegura Zabalegui de iAdvize.

Éxito entre las generaciones maduras

Aunque los más mayores son los más renuentes a la adopción de nuevas tecnologías, no es el caso de los chatbots. "Estamos viendo un nicho de mercado que no contemplábamos entre quienes están por encima de los 55 años. Es gente que vio pasar el tren de las compras por internet porque no quiere meter los datos de su tarjeta de crédito o cuenta bancaria en el ordenador, pero que ahora ve en los chatbots una forma mucho más sencilla de comunicarse y realizar operaciones", asegura Prim, de correYvuela.

Hay quien plantea un futuro en el que estos chatbots, la inteligencia artificial, sean no solo un asistente personal, sino algo más emocional. Algo que ya se ha llevado a la gran pantalla en múltiples ocasiones, caso de Her, interpretada por Joaquín Phoenix. Pero, de momento, parece ser solo ficción

"El objetivo prioritario de los chatbot es la de integrarse en el servicio de atención al cliente con el fin de reducir costes y optimizar la experiencia del usuario en lo relativo a la comunicación multicanal entre usuario y empresa. Por el momento, y teniendo en cuenta que el 60% de las empresas no conocen esta tecnología, creo que es apresurado decir que en un futuro cercano se crearan chatbots que ejerzan e rol de amigo. Sin embargo, en el mundo de la tecnología nada es imposible, así quién sabe si en el futuro veremos algo parecido…", concluye Zabalegui.

Ya no se pueden votar ni publicar comentarios en este artículo.