La personas que han perdido por completo la movilidad utilizan diversos interfaces para comunicarse a partir de gestos de sus ojos o de su lengua. Aunque estos sistemas pueden mejorar mucho su calidad de vida, la mayoría de estas tecnologías permiten escribir con gran esfuerzo a un ritmo de apenas 10 palabras por minuto, que contrasta con las 150 palabras por minuto que puede pronunciar una persona en una conversación normal. Para mejorar esta capacidad de comunicarse, el equipo de Edward Chang, de la Universidad de California, San Francisco, ha diseñado un sistema que puede traducir directamente la señal desde el cerebro y reducir los tiempos.

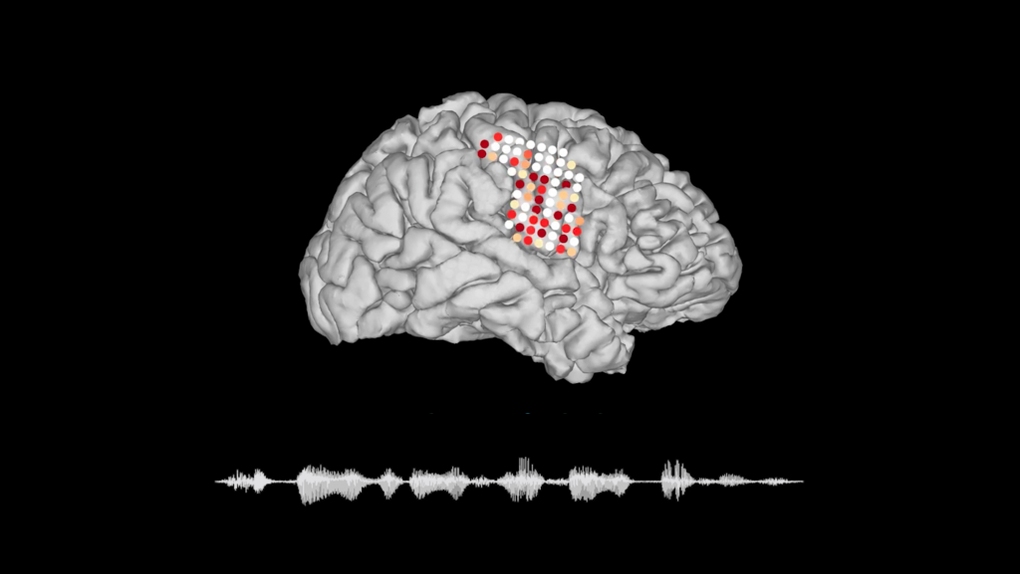

La nueva tecnología se presenta en un trabajo publicado este miércoles en la revista Nature y es una especie de sintetizador que registra la señal a nivel subdural (bajo el cráneo) y las convierte en palabras habladas. Los autores han utilizado la manta de electrodos que se coloca a pacientes epilépticos para localizar el foco que provoca los ataques para monitorizar los patrones de actividad neuronal mientras pronunciaban centenares de palabras en voz alta. A partir de esta señal de electrocorticografía (ECog) los autores identificaron las señales que se producen cuando el sujeto mueve la mandíbula, la laringe, los labios y la lengua y diseñaron un programa que convirtiera estas señales en palabras. En las pruebas, los voluntarios escucharon 101 frases producidas por el sistema y pudieron identificarlas y transcribirlas.

Los autores han utilizado la manta de electrodos que se coloca a pacientes epilépticos

Para asegurarse, diseñaron un sistema similar a partir de las señales registradas en un voluntario al que pidieron que en lugar de pronunciar las palabras moviera la boca como si las dijera pero sin emitir sonidos. Aunque los resultados fueron peores, los autores creen que también sería posible descodificar palabras que se pronuncian de forma motora sin llegar a hacerlas audibles. Estos sistemas de interpretación del movimiento muscular de la laringe se han probado en el pasado sin demasiado éxito debido al coste y la escasa operatividad de la tecnología. En el caso de la nueva estrategia de Chang y su equipo, cuenta con la clara desventaja de tratarse de un sistema invasivo que requeriría su implante bajo el cráneo, con los inconvenientes y riesgos que esto conlleva. En cualquier caso, quedaría un largo camino de ensayos para convertirlo en un dispositivo real.

Referencia: Speech synthesis from neural decoding of spoken sentences (Nature) DOI 10.1038/s41586-019-1119-1

Ya no se pueden votar ni publicar comentarios en este artículo.